El timeline de las interfaces de voz

Una incompleta historia de los asistentes de voz

Federico Block

11 de Diciembre de 2018

Cuando comencé a preparar esta línea de tiempo esperaba que una docena de hitos alcanzaran para desarrollar la historia, dos semanas después llego a la conclusión de que esta será una publicación viva en la que iré agregando nuevos elementos a partir de la investigación para otras notas y de nuevos eventos que acontezcan en torno al tema.

Clasifiqué cada entrada en grupos que fueron tomando sentido a partir de los elementos.

Síntesis de voz, donde entran los diferentes esfuerzos por producir de manera artificial un simulacro de voz humana inteligible. Es interesante cuán remotos son los antecedentes en este campo.

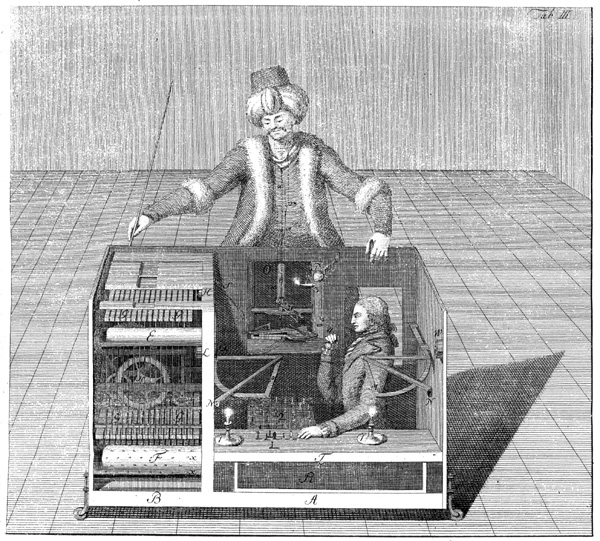

Plagado de anécdotas e historias sorprendentes, por ejemplo, Von Kempelen que desarrollo uno de los más complejos y tempranos proyectos de síntesis de voz es el autor de “El Turco”, aquél autómata que jugaba al ajedrez que llegó a jugar con Benjamin Franklin e incluso con Napoleón Bonaparte y que finalmente resultó un engaño.

La Comprensión de Lenguaje Natural, es en si misma toda una línea de la inteligencia artificial que se considera de las ramas duras, de las necesarias para solucionar el problema central de desarrollar sistemas inteligentes. Desafíos que no pueden resolverse con sólo un algoritmo.

Wolfgang von Kempelen El Turco

Existen diferentes aproximaciones teóricas que tuvieron sus momentos de auge a lo largo de los últimos cincuenta años.

Influidos por la linguística, las matemáticas y hasta los movimientos sociales, los teóricos moldearon lenguajes de programación, arquitectura de ordenadores y marcos conceptuales. Según algunos la ley de Moore abrió las puertas al uso de una brutal capacidad de cómputo para resolver problemas con aproximaciones demasiado sencillas o que pueden esquivar temporalmente la complejidad de extraer sentido.

La diferencia clave reside en si es posible reducir el problema a un análisis estadístico como el de los algoritmos más difundidos del Machine Learning actual o si es indispensable la construcción de un modelo conceptual.

Roger Schank pionero de la IA introdujo el modelo de Teoría de la Dependecia Conceptual en Stanford en el año 1969. Su tweet nos deja claro de que lado se posiciona.

Finally, a Machine That Can Finish Your Sentence https://t.co/8ZGgYTBZKS Finally? we have been waiting for years for a machine that can guess what you wanted to say without understanding any of it?

— Roger Schank (@rogerschank) November 24, 2018

El Reconocimiento del Habla, que utiliza elementos de reconocimiento para discernir el sentido de elementos individuales, como palabras, extraídos de un registro, por ejemplo, sonoro o visual.

La capacidad de comprensión alcanzada en los últimos 3 años, sí, los últimos tres años, ha permitido cruzar el nivel de comprensión medio de una persona normal que es del 95%.

Esto ha hecho que interactuar con la voz pase de ser un incordio -aún podemos vivir la experiencia hablando con el banco- a utilizarla con los dispositivos que nos rodean de forma completamente natural.

Los Bots, chatbots o Bots Conversacionales para ser más precisos.

Se denominan así los programas capaces de simular una conversación, por lo general restringiendo el campo a un tema en particular.

Los avances recientes en Síntesis de voz y en Comprensión del habla han disparado las oportunidades de uso.

Los Asistentes, bots especializados en algún tipo de función.

Específicos como los Microsoft Agents para dar ayuda acerca de un programa en particular.

Tan genéricos como Google Assistant que se nutre de la información a la que accede su indexación de la web.

Así como los capaces de extender su funcionalidad de manera programática como Alexa.

Por último, un enorme cajón de sastre donde encontrareis hitos claves de la industria.

Sobre todo espero que disfrutéis de esta obra inconclusa que mantendré en constante progreso.

Toda sugerencia es bienvenida. Puedes encontrarme en federico.block@mindgeist.com